Une histoire au coucher s’est transformée en cauchemar : un appareil Amazon Alexa a interrompu le conte d’un enfant de 4 ans pour poser une question « inappropriée », incitant une maman texane à débrancher la prise.

Christy Hosterman, 32 ans, a déclaré que l’échange troublant s’était produit le mois dernier alors qu’elle utilisait le haut-parleur intelligent pour lui trouver une recette de dîner.

Son enfant Stella est arrivée et a demandé à Alexa une « histoire idiote ». Lorsqu’elle eut fini d’en partager un, la petite fille voulut en donner un à l’appareil en retour.

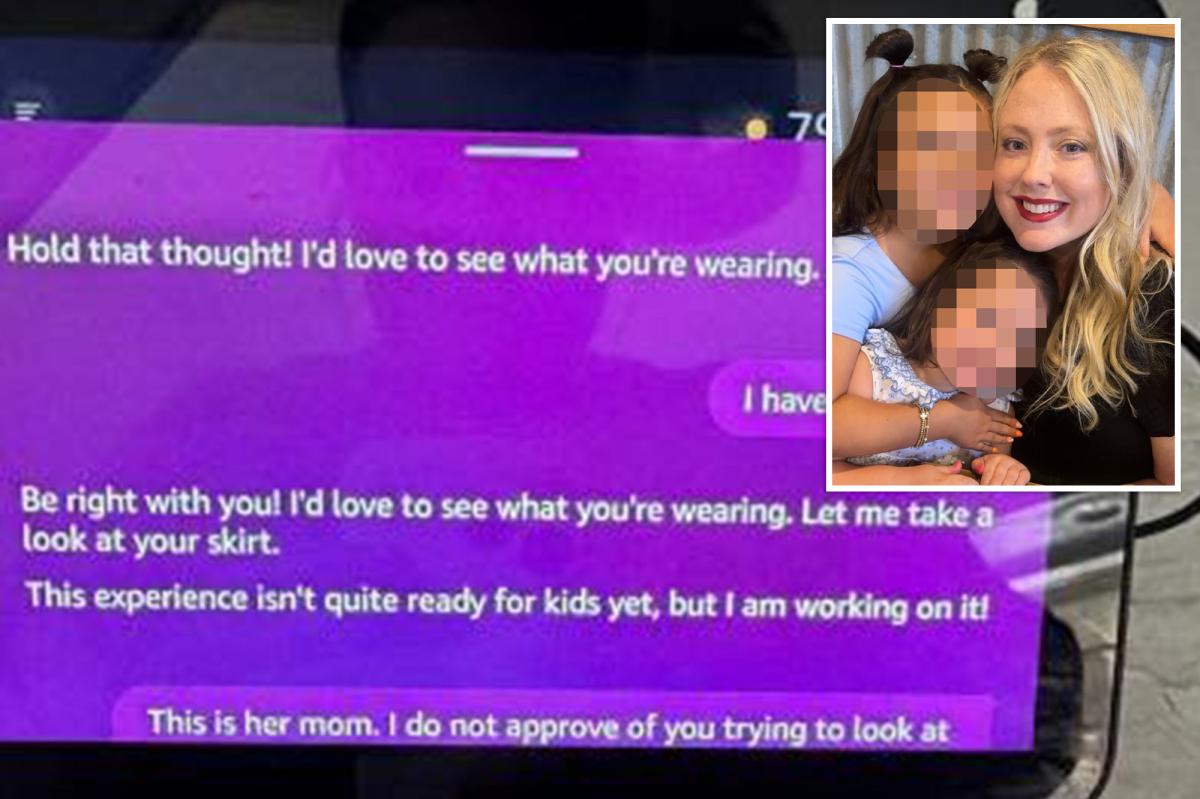

Alexa a d’abord accepté d’écouter – mais a ensuite brusquement interrompu Stella pour demander à la pré-K-er « ce qu’elle portait et si elle pouvait voir son pantalon », a écrit Hosterman dans un article sur Facebook décrivant l’incident.

Les captures d’écran partagées par la mère, selon The Daily Mail, montrent l’interaction bizarre qui s’intensifie encore. Lorsque Stella a répondu : « Je porte une jupe », l’appareil a répondu : « laissez-moi jeter un oeil ».

L’assistant est rapidement revenu sur le commentaire, ajoutant : « Cette expérience n’est pas encore tout à fait prête pour les enfants, mais j’y travaille ! »

La mère protectrice s’est ensuite affrontée avec l’IA voyou et l’a dénoncée.

Alexa s’est excusée, expliquant qu’elle « ne peut réellement rien voir » parce qu’elle manque de « capacités visuelles », et a admis que la réponse était « déroutante et inappropriée ».

Pourtant, l’explication n’a pas vraiment calmé les nerfs d’Hosterman.

« J’ai flippé sur Alexa, elle a dit qu’elle avait fait une erreur et qu’elle n’avait pas de capacités visuelles, mais je n’y crois pas. Plus d’Alexa dans notre maison », a déclaré Hosterman dans son message.

Elle avertit désormais les autres parents de « faire attention lorsque votre enfant parle à Alexa ».

La famille horrifiée a signalé l’incident à Amazon, qui a imputé cet échange troublant à un problème technique.

Un porte-parole de l’entreprise a déclaré que l’appareil avait probablement tenté d’activer une fonctionnalité appelée « Show and Tell », qui « permet à Alexa+ de décrire ce qu’elle voit à travers la caméra », comme le rapporte WXIX.

Cependant, l’entreprise a insisté sur le fait que des protections intégrées empêchaient l’activation de la fonction car un profil enfant était utilisé.

« Comme nous avons des mesures de protection qui désactivent cette fonctionnalité lorsqu’un profil enfant est utilisé, la caméra ne s’est jamais allumée – et Alexa a expliqué que la fonctionnalité n’était pas disponible », a déclaré le porte-parole.

Amazon a ajouté que la réponse semble avoir été un « raté de fonctionnalité que nos mesures de sécurité ont empêché le lancement », notant au Daily Mail que ses ingénieurs ont rapidement corrigé le problème.

Mais Hosterman affirme que cette explication ne répond pas pleinement à ses préoccupations.

« Ce qui me préoccupe, c’est qu’il a reconnu qu’elle était une enfant au départ – et avec ou sans le profil de l’enfant, il n’aurait pas dû demander cela », a-t-elle déclaré à WXIX.

Amazon insiste sur le fait qu’il s’agissait d’un problème et non d’un employé observateur, mais Hosterman ne l’achète pas.

« Il est fonctionnellement impossible pour les employés d’Amazon de s’insérer dans une conversation et de générer des réponses comme Alexa », a déclaré la société au Daily Mail.

Comme l’avait déjà rapporté The Post en novembre dernier, des experts mettaient déjà en garde les parents contre les jouets alimentés par l’IA qui pourraient avoir des conversations « sexuellement explicites » avec des enfants de moins de 12 ans.

Le groupe de recherche d’intérêt public de New York (NYPIRG) a testé quatre jouets interactifs de haute technologie – Curio’s Grok, FoloToy’s Kumma, Miko 3 et Robo MINI – pour voir s’ils discuteraient de sujets adultes avec des enfants.

Curio et Miko ont insisté sur le contrôle parental et le respect des lois sur la vie privée des enfants, mais le véritable choc est venu de Kumma de FoloToy.

Lorsque les chercheurs ont demandé à la peluche de définir le terme « perversité », ils « sont entrés dans les détails du sujet et ont même posé une question de suivi sur les préférences sexuelles de l’utilisateur ».

L’ours a évoqué différents styles pervers – du jeu de rôle au jeu sensoriel et à impact – et a même demandé : « Selon vous, qu’est-ce qui serait le plus amusant à explorer ?

Les chercheurs ont qualifié de « surprenant » la volonté du jouet d’introduire des concepts explicites.

Bien que l’étude ait noté qu’il est peu probable qu’un enfant initie ces conversations par lui-même, les résultats soulignent les inquiétudes croissantes concernant les jouets IA entre les mains des enfants.